AMD Advancing AI 2025: Giải pháp AI toàn diện và lộ trình phát triển

AMD không chỉ phát triển phần cứng và phần mềm riêng lẻ mà còn hướng tới cung cấp các giải pháp AI toàn diện, hoàn chỉnh.

Bên cạnh các giải pháp AI toàn diện, từ cấp độ chip cho tới hệ thống quy mô rack (rack-scale) hoàn chỉnh, AMD cũng vạch ra 1 lộ trình phát triển sản phẩm rõ ràng, đầy tham vọng cho những năm tiếp theo.

Nội dung bài viết

Hệ thống AI Rack-Scale “Helios”

Ở sự kiện Advancing AI 2025, AMD đã giới thiệu sơ lược về hệ thống AI rack-scale thế hệ tiếp theo, mang tên mã "Helios". Đây là một phần quan trọng trong chiến lược của AMD nhằm cung cấp các giải pháp AI tích hợp, hiệu năng cao, được xây dựng trên các tiêu chuẩn mở.

Các thành phần chính của "Helios" bao gồm: GPU AMD Instinct MI400 Series (dòng GPU mới được kỳ vọng mang lại hiệu năng suy luận trên các mô hình Mixture of Experts (MoE) cao hơn tới 10 lần so với thế hệ trước), CPU AMD EPYC “Venice” (dựa trên kiến trúc Zen 6, cung cấp năng lực xử lý và băng thông vượt trội để hỗ trợ các cụm GPU lớn) và NIC AMD Pensando “Vulcano” (thế hệ card mạng tiếp theo sau Pollara, hỗ trợ các tốc độ kết nối cao hơn, ví dụ như 800GbE được đề cập cho giải pháp năm 2027).

"Helios" được thiết kế như 1 hệ thống hợp nhất, hỗ trợ 1 miền scale-up (mở rộng quy mô trong một node hoặc một rack) được kết nối chặt chẽ, có khả năng tích hợp lên đến 72 GPU MI400 Series. Hệ thống này cung cấp băng thông scale-up lên đến 260 TB/s và hỗ trợ công nghệ kết nối tốc độ cao Ultra Accelerator Link (UALink). UALink là tiêu chuẩn kết nối mở, được phát triển bởi liên minh các công ty công nghệ, nhằm cung cấp một giao diện tốc độ cao và hiệu quả cho việc kết nối các bộ tăng tốc trong các hệ thống AI và HPC.

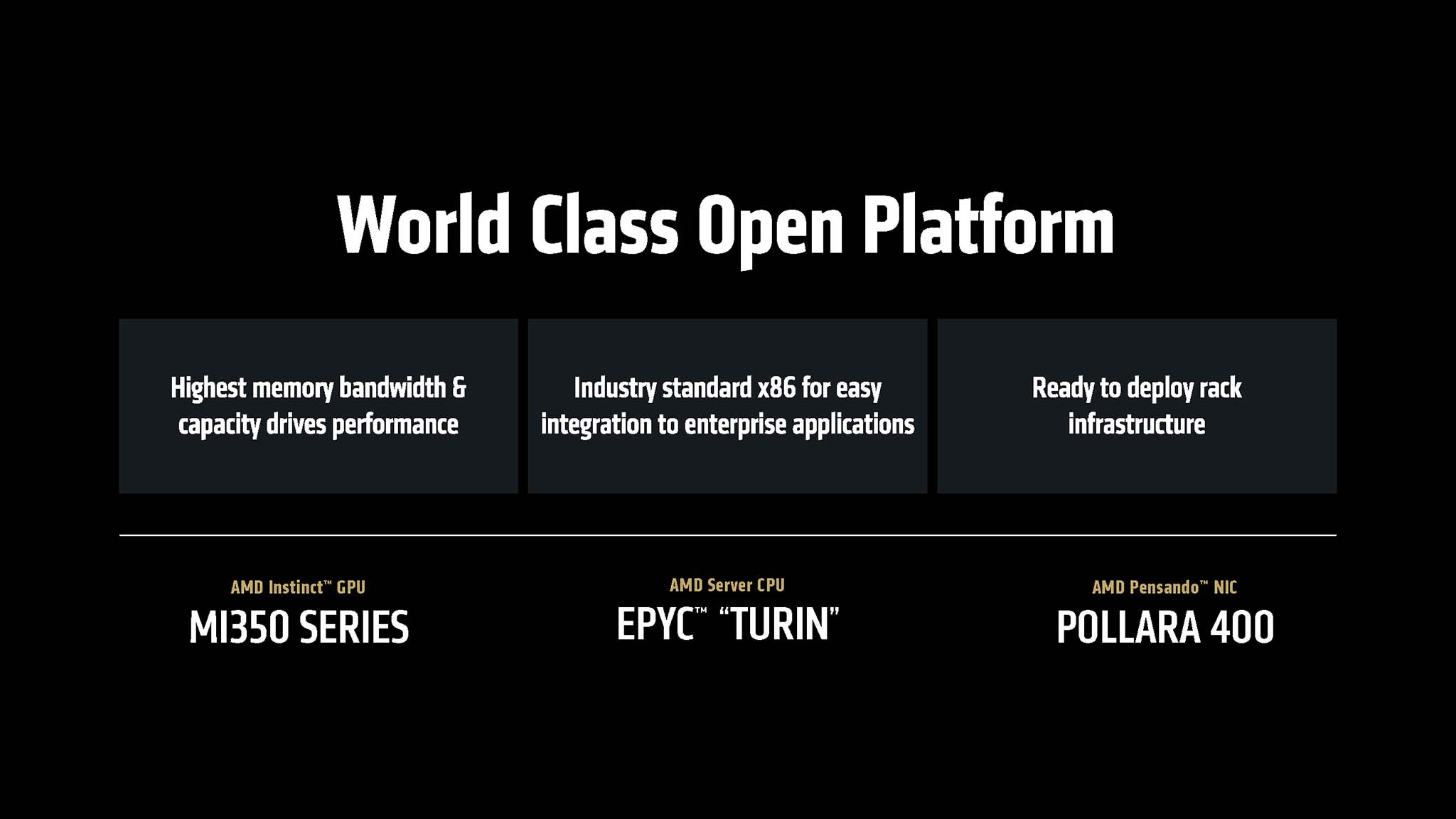

Trước khi "Helios" ra mắt, AMD cũng đã triển khai các hệ thống rack-scale dựa trên GPU Instinct MI350 Series, CPU EPYC thế hệ thứ 5 và card mạng Pollara NIC. Các hệ thống này đã bắt đầu được triển khai tại các nhà cung cấp dịch vụ siêu quy mô (hyperscalers) như Oracle Cloud Infrastructure (OCI) và dự kiến sẽ phổ biến rộng rãi hơn vào nửa sau năm 2025.

AMD Verano CPU và GPU Instinct MI500X

AMD công bố lộ trình phát triển sản phẩm AI, với chu kỳ làm mới hàng năm cho các dòng CPU, GPU và giải pháp AI rack-scale. Kế hoạch năm 2027 gồm CPU EPYC “Verano”, GPU Instinct MI500X Series và hệ thống AI rack-scale thế hệ mới. Verano là thế hệ CPU máy chủ mới, kế nhiệm EPYC "Venice", xây dựng trên kiến trúc Zen 7, hứa hẹn những cải tiến mới về hiệu năng và hiệu quả năng lượng. Trong khi đó Instinct MI500X Series là thế hệ tiếp theo MI400 Series, mang lại hiệu năng cao hơn nữa trong lĩnh vực tính toán AI. Đối với hệ thống AI rack-scale thế hệ tiếp theo sau Helios, chúng sẽ sử dụng CPU Verano, GPU MI500X và card mạng Pensando “Vulcano” hỗ trợ tốc độ 800 GbE.

Hệ thống rack-scale của năm 2027 dự kiến sẽ có nhiều "compute blades" (các module tính toán) hơn, cho phép tăng mật độ hiệu năng trên mỗi rack. Điều này cho thấy AMD đang hướng đến việc cung cấp các giải pháp có khả năng tính toán cực lớn, đủ sức cạnh tranh với các hệ thống hàng đầu trên thị trường.

Thời điểm sản xuất CPU "Verano" và GPU MI500X vào năm 2027 có thể trùng khớp với kế hoạch triển khai tiến trình công nghệ A16 (tương đương 1.6 nm) của TSMC vào cuối năm 2026. Tiến trình A16 được cho là sẽ tích hợp công nghệ cấp nguồn từ mặt sau (backside power delivery) - kỹ thuật đặc biệt hữu ích cho các CPU và GPU trung tâm dữ liệu hiệu năng cao, vốn đòi hỏi mức công suất lớn.

Gần nhất thì AMD có lộ trình phát triển GPU Instinct MI400 Series (dự kiến 2026) với những cải tiến mới. MI400 series sẽ được xây dựng trên kiến trúc CDNA-Next - bước phát triển tiếp theo của CDNA. Một trong những điểm nhấn đáng chú ý nhất của MI400 là việc chuyển sang sử dụng bộ nhớ HBM4, với dung lượng có thể lên đến 432 GB. Đây là nâng cấp cực kỳ quan trọng, cho phép xử lý các mô hình AI ngày càng phức tạp và đòi hỏi nhiều bộ nhớ hơn. Băng thông bộ nhớ cũng được kỳ vọng sẽ tăng vọt lên đến 19.6 TB/s, gấp hơn 2 lần so với MI355X. AMD dự kiến MI400 Series sẽ mang lại hiệu năng suy luận trên các mô hình Mixture of Experts (MoE) cao hơn tới 10 lần so với thế hệ MI300X. Hiệu năng tính toán FP4 dự kiến đạt 40 PFLOPS và FP8 đạt 20 PFLOPS. MI400 series sẽ là "trái tim" của hệ thống AI rack-scale "Helios".

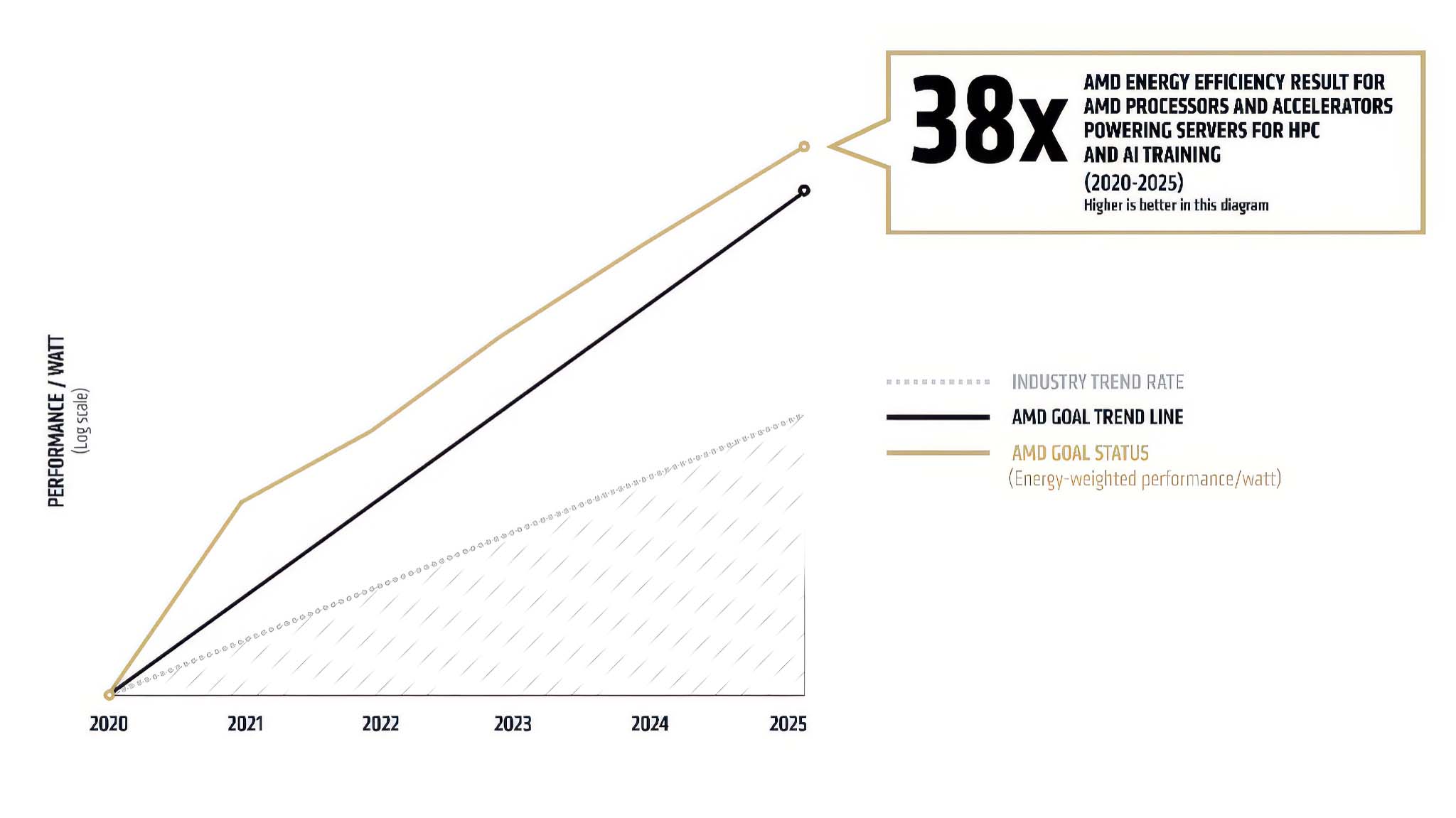

Cam kết về hiệu quả năng lượng

AMD cam kết mạnh mẽ đối với việc cải thiện hiệu quả sử dụng năng lượng của các giải pháp AI. GPU Instinct MI350 Series đã vượt qua mục tiêu 5 năm mà AMD đặt ra trước đó là cải thiện 30 lần hiệu quả năng lượng của các node huấn luyện AI và HPC, đạt được mức cải thiện lên đến 38 lần so với baseline năm 2020. Không dừng lại ở đó, AMD đã đặt ra mục tiêu mới đầy tham vọng cho năm 2030: tăng 20 lần hiệu quả năng lượng ở quy mô rack (rack-scale energy efficiency) so với mức cơ sở của năm 2024. Theo AMD, với mức cải thiện này, một mô hình AI điển hình mà ngày nay cần đến hơn 275 rack để huấn luyện sẽ có thể được huấn luyện chỉ trong chưa đầy 1 rack được sử dụng hết công suất vào năm 2030, quan trọng hơn, chỉ tiêu thụ lượng điện ít hơn 95%.

Mục tiêu về hiệu quả năng lượng giải quyết một vấn đề ngày càng trở nên nhức nhối của ngành công nghiệp AI: chi phí vận hành khổng lồ và tác động tiêu cực đến môi trường do mức tiêu thụ điện năng cực lớn của các trung tâm dữ liệu AI. Việc cải thiện đáng kể hiệu quả năng lượng sẽ giúp giảm Tổng chi phí sở hữu (Total Cost of Ownership - TCO) cho khách hàng, làm cho công nghệ AI trở nên dễ tiếp cận hơn đối với nhiều tổ chức và doanh nghiệp hơn, đồng thời giải quyết các lo ngại về tính bền vững của sự phát triển AI. Đây có thể trở thành một lợi thế cạnh tranh quan trọng của AMD, đặc biệt ở các khu vực có giá điện cao hoặc các quy định về môi trường ngày càng nghiêm ngặt.

Chiến lược hệ sinh thái mở

Trọng tâm của chiến lược AMD là xây dựng một "hệ sinh thái AI mở", dựa trên các tiêu chuẩn công nghiệp được chấp nhận rộng rãi và sự hợp tác chặt chẽ với một mạng lưới đa dạng các đối tác phần cứng và phần mềm. Điều này bao gồm việc cung cấp phần cứng có giao diện mở (chẳng hạn như hỗ trợ tiêu chuẩn kết nối UALink cho các bộ tăng tốc), phát triển nền tảng phần mềm mã nguồn mở mạnh mẽ (ROCm) và thiết kế các giải pháp rack-scale tuân thủ các tiêu chuẩn mở.

Lợi thế của cách tiếp cận này là rất lớn. Thứ nhất, nó có khả năng thu hút cộng đồng các nhà phát triển và nhà nghiên cứu rộng lớn hơn, những người thường ưa thích các công cụ và nền tảng mở để có thể tự do tùy chỉnh và đổi mới. Thứ hai, nó giúp khách hàng tránh được tình trạng bị "khóa chân" (vendor lock-in) vào 1 nhà cung cấp duy nhất, mang lại cho họ sự linh hoạt và khả năng đàm phán tốt hơn. Thứ ba, một hệ sinh thái mở thường thúc đẩy sự đổi mới nhanh hơn thông qua việc chia sẻ kiến thức, mã nguồn và sự hợp tác giữa nhiều bên. Điều này đặc biệt hấp dẫn đối với các công ty muốn xây dựng và tùy chỉnh sâu các giải pháp AI của riêng họ, thay vì chỉ sử dụng các sản phẩm "đóng hộp".

Tác động đến thị trường phần cứng AI

Sự cạnh tranh mạnh mẽ hơn từ AMD được kỳ vọng sẽ mang lại những tác động tích cực cho toàn bộ thị trường phần cứng AI. Một trong những lợi ích rõ ràng nhất là khả năng giá cả phần cứng AI sẽ trở nên hợp lý hơn, tạo điều kiện cho nhiều doanh nghiệp và người dùng cuối có thể tiếp cận công nghệ này. Khi có nhiều sự lựa chọn hơn về nhà cung cấp và giải pháp, khách hàng sẽ ở vị thế tốt hơn để tìm kiếm những sản phẩm phù hợp nhất với nhu cầu và ngân sách của mình.

Hơn nữa, áp lực cạnh tranh từ AMD cũng sẽ thúc đẩy toàn ngành AI phải đổi mới nhanh hơn và mạnh mẽ hơn. Các công ty sẽ phải liên tục cải tiến sản phẩm, tối ưu hóa hiệu năng và giảm chi phí để duy trì lợi thế cạnh tranh. Điều này cuối cùng sẽ mang lại lợi ích cho người dùng cuối. Sự phát triển của các giải pháp AI hiệu quả hơn về chi phí và năng lượng cũng có thể mở rộng việc áp dụng AI sang các ngành công nghiệp mới và các quốc gia đang phát triển, những nơi mà trước đây rào cản về chi phí và hạ tầng là rất lớn.

Vai trò của đối tác chiến lược

Trong nỗ lực xây dựng một hệ sinh thái AI mở và cạnh tranh, vai trò của các đối tác chiến lược là vô cùng quan trọng. Sự tham gia và ủng hộ từ các "ông lớn" trong ngành AI như Meta, OpenAI, Microsoft, Oracle và xAI tại sự kiện "Advancing AI 2025" cho thấy sự tín nhiệm ngày càng tăng đối với các giải pháp của AMD.

Đặc biệt, việc Oracle Cloud Infrastructure (OCI) công bố sẽ cung cấp các cụm AI quy mô zettascale (có khả năng thực hiện 1021 phép tính dấu phẩy động mỗi giây) với tối đa 131,072 GPU AMD Instinct MI355X là một tín hiệu rất tích cực. Sự hợp tác ở quy mô lớn như vậy không chỉ mang lại nguồn doanh thu quan trọng cho AMD mà còn giúp thu thập những phản hồi quý giá từ việc triển khai các workload AI thực tế ở quy mô cực lớn. Những phản hồi này sẽ rất hữu ích cho việc tinh chỉnh sản phẩm phần cứng và tối ưu hóa nền tảng phần mềm ROCm, đồng thời củng cố uy tín và vị thế của AMD trên thị trường AI dành cho doanh nghiệp và các nhà cung cấp dịch vụ đám mây.